紹介

DeepSeek V3は、高度なAIタスクのために設計された強力な言語モデルです。

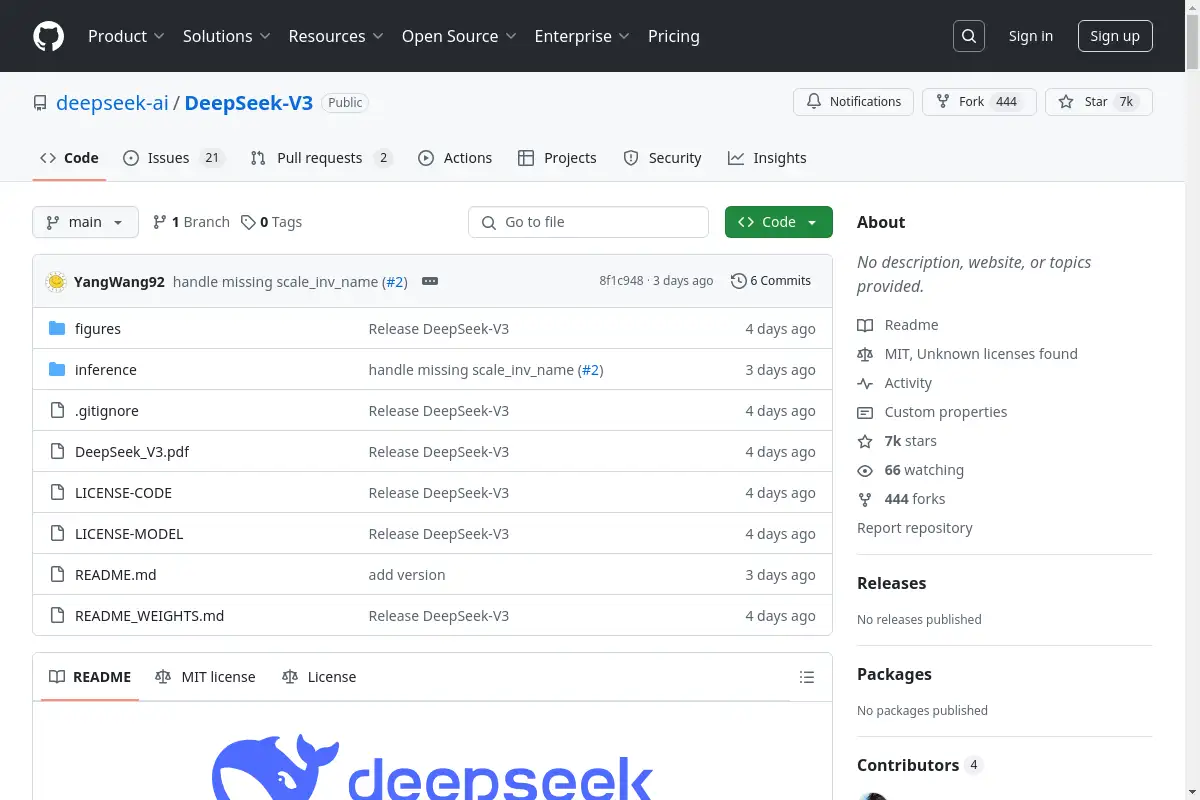

DeepSeek V3とは?

DeepSeek V3は、deepseek-aiによって開発された最先端のMixture-of-Experts (MoE)言語モデルです。6710億の総パラメータを持ち、各トークンに対して370億が有効化されており、自然言語処理タスクにおいて最先端の性能を提供します。このモデルは、Multi-head Latent Attention (MLA)を含む革新的なトレーニング戦略と、負荷分散のための独自の補助損失なしの戦略を採用しており、効率的かつ効果的です。

DeepSeek V3のコア機能

革新的なアーキテクチャ

- Mixture-of-Experts (MoE): 各トークンに対してパラメータの一部のみを使用し、効率的な処理を実現します。

- Multi-Token Prediction (MTP): 性能を向上させ、推測的デコーディングを可能にすることで、より迅速な推論を実現します。

高度なトレーニング効率

- FP8混合精度トレーニング: 大規模なトレーニング効率を達成します。

- コスト効率の良いトレーニング: 完全なトレーニングに必要なH800 GPU時間はわずか278.8万時間であり、他のモデルと比べて経済的です。

包括的な評価

- ベンチマーク性能: 多くの既存のオープンソースモデルを上回り、主要なクローズドソースモデルと競争力があります。

- 安定したトレーニングプロセス: 回復不可能な損失のスパイクを回避し、トレーニング全体を通じて信頼性を確保します。

DeepSeek V3の使用例

自然言語処理

- テキスト生成: 高品質で文脈に関連したテキストを生成します。

- 質問応答: 広範なトレーニングデータに基づいて、ユーザーの質問に正確な回答を提供します。

コード生成

- プログラミング支援: 開発者にコードの提案やデバッグを手助けします。

- 自動コードレビュー: コードの品質を分析し、フィードバックを提供します。

数学問題解決

- 数学問題解決: 複雑な数学方程式や問題を効率的に解決します。

- 教育ツール: 学習環境における学生や教育者のためのリソースとして機能します。

DeepSeek V3の使い方

DeepSeek V3を使用するには、開発者はHuggingFaceなどのプラットフォームからモデルをダウンロードできます。ダウンロード後、GitHubページにある提供されたドキュメントに従って、ローカル環境にモデルをセットアップします。「ローカルでの実行方法」セクションに詳細な手順があります。

DeepSeek V3の対象ユーザー

- AI研究者

- 開発者およびプログラマー

- 教育機関

- データサイエンティスト

- テクノロジー愛好者

DeepSeek V3は無料ですか?

DeepSeek V3はオープンソースモデルとして利用可能です。ユーザーは無料でダウンロードして利用できますが、使用に応じて必要な計算リソースにコストが発生する場合があります。

DeepSeek V3に関するよくある質問

DeepSeek V3のシステム要件は何ですか?

DeepSeek V3は、最適なトレーニングと推論のために高性能のGPUへのアクセスを必要とします。

DeepSeek V3は他のモデルと比べてどうですか?

多くの他のオープンソースモデルを上回り、主要なクローズドソースの代替品と密接に競争しています。

DeepSeek V3の開発に貢献できますか?

はい、GitHubを通じての貢献は歓迎されており、コミュニティはフィードバックや改善を提供することが奨励されています。

DeepSeek V3のタグ

- AI

- 言語モデル

- オープンソース

- 自然言語処理

- 機械学習

- コード生成

- 数学